Roboter utfører stadig flere oppgaver i industrien, men det trengs fortsatt mennesker til mange kompliserte handlinger. Eksempler på dette er håndtering og bearbeiding av matvarer.

– Om vi skal ha som mål å automatisere noen eller alle disse oppgavene i industrien, eller andre steder, må vi tilføre robotene ny kunnskap via læring. De må lære såkalte myke egenskaper, slik at de kan utføre operasjoner på samme nivå som mennesker i fremtiden, sier SINTEF-forsker Ekrem Misimi, som utvikler robotlæringsteknologi i prosjektet iProcess.

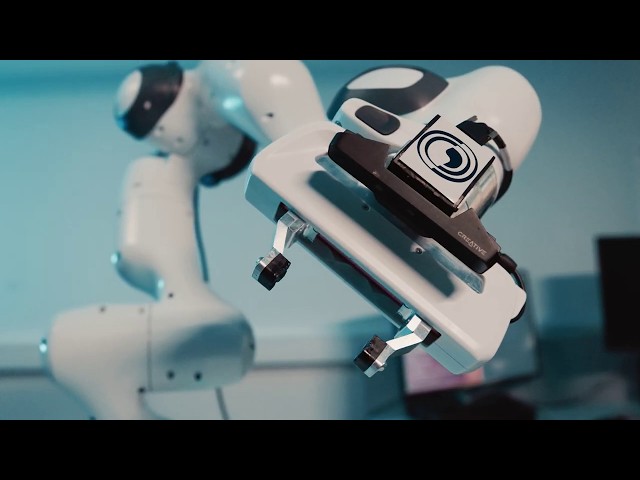

For å lære robotene disse komplekse egenskapene kreves det en kombinasjon av visuell og taktil læring – de må på en måte lære å se og føle.

Ekrem Misimi i laben. Her lærer roboten å gripe en minitomat. Foto: TYD

Det kan være nyttig også i et større perspektiv, nå når mange mennesker må jobbe hjemmefra, eller holde seg unna jobb på grunn av smittefare:

– For samfunnet er produksjon, men også høsting, håndtering og bearbeiding av mat kritiske funksjoner. Vår teknologi kan ivareta en helautomatisert produksjon som er basert på intelligente roboter. Intelligent robotteknologi kan rett og slett gjøre oss bedre rustet som samfunn i dårlige tider, men også effektivisere produksjonen og verdiskapning i gode tider, sier Ekrem Misimi.

Kan læres opp til mye

Samspillet mellom en robot og objekter som er myke, skjøre, bløte eller formbare, er en av de største utfordringene innen robotikk i dag, fordi råstoffet endrer form og fasong ved håndtering. For oss mennesker er det lett å følge etter og kompensere for dette i sanntid, men roboten trenger avanserte visuelle og fintfølende sanser for å få det til.

Roboten må derfor få kunstige «øyne» i form av 3D-syn, kunstig «hjerne» fra kunstig intelligens, og følsomme «hender» som baserer seg på kraft og taktil sansing.

– Ved hjelp av disse egenskapene kan vi gi robotene en oppgavespesifikk intelligens, som er god nok til å gjøre jobben automatisk, sier Misimi.

- Les også Roboten – den nye bonden?

Lærer komplekse oppgaver fra enkle eksempler

Roboten er i seg selv uintelligent, så alt man ønsker å få den til å gjøre må tilføres gjennom sansing og læring, enten i interaksjon med mennesker eller på egenhånd.

– Ambisjonen er å få roboten til å lære komplekse oppgaver fra noen enkle eksempler, sier Misimi.

I iProcess prosjektet er det derfor utviklet to metoder for robotlæring. Det første er via læring fra demonstrasjon som binder sammen den visuelle og taktile sansingen for å gripe myke matobjekter. Det andre er å la roboten lære oppgaven på egenhånd i et simulert miljø med støtte fra kunstig intelligens, før den til slutt testes i den virkelige verden. Prosjektet har generert mange interessante oppgaver for masterstudenter fra NTNU innenfor kunstig intelligens og robotikk.

– En vanlig utfordring ved robotlæring er at operatøren, altså læreren, demonstrerer oppgaven feil for roboten. Derfor har vi utviklet en læringsstrategi som baserer seg på kun de beste demonstrasjonene, og dermed automatisk forkaster de dårlige. Læringsstrategien bruker 3D-bildene for riktig posisjonering av roboten og taktil sansingen for skånsom griping av objektene, sier Misimi.

- Les også Mer mat fra maten med roboter

Det som er spesielt interessant med egenlæring er at roboten aldri har sett en laksefiletporsjon, verken i et simulert eller virkelig miljø. Men den klarer likevel utmerket godt å generalisere i den reelle verden for å håndtere de nye ukjente objektene, forklarer Misimi.

Når roboten lærer på denne måten forkortes opplæringstiden betraktelig, samtidig som roboten kan brukes til å håndtere flere matprodukter, eller andre lignende objekter, uten noe tilleggsprogrammering.

Forskningen er publisert i Robotic Handling of Compliant Food Objects by Robust Learning from Demonstration, under International Conference on Intelligent Robots and Systems. Mens artikkelen om egenlæring er akseptert under den kommende International Conference on Robotics and Automation (ICRA) 2020*.

Kan læres opp til mye

Roboten kan læres opp til mange forskjellige håndteringsoppgaver. Fra griping av objekter i ro og av industriobjekter i bevegelse, til mer kompliserte oppgaver som krever større behendighet og læring, som for eksempel manipulasjon av objekter i bevegelse.

– Det kan være kutting og griping av objekter som krever skånsom behandling. Enten det er en fiskefilet eller salat må roboten være så fintfølende at den ikke skader produktene, samtidig som den gjør jobben, sier Misimi.

Viktig for norsk matindustri

Den nye teknologien vil være viktig for norsk matindustri og andre bransjer der det er nyttig å løse robothåndtering av føyelige og formfulle objekter, og som er helt avhengig av å automatisere for å beholde verdiskapningen i Norge.

– Dette prosjektet er en milepæl for å realisere den visjonen. Robotteknologien vil kunne øke både konkurranseevnen og lønnsomheten, og gjøre det mulig å bearbeide en større andel av råstoffet i Norge. Dette kan bidra til å øke kvaliteten på produktene og redusere matsvinn. Dessuten vil det spare miljøet for transport til utlandet for foredling av råvarene, slik man ofte må i dag, sier Misimi.

* O-M. Pedersen, E. Misimi, F. Chaumette, «Grasping Unknown Objects by Coupling Deep Reinforcement Learning, Generative Adversarial Networks, and Visual Servoing», ICRA’20 – IEEE International Conference on Robotics and Automation, 2020, Paris, France.